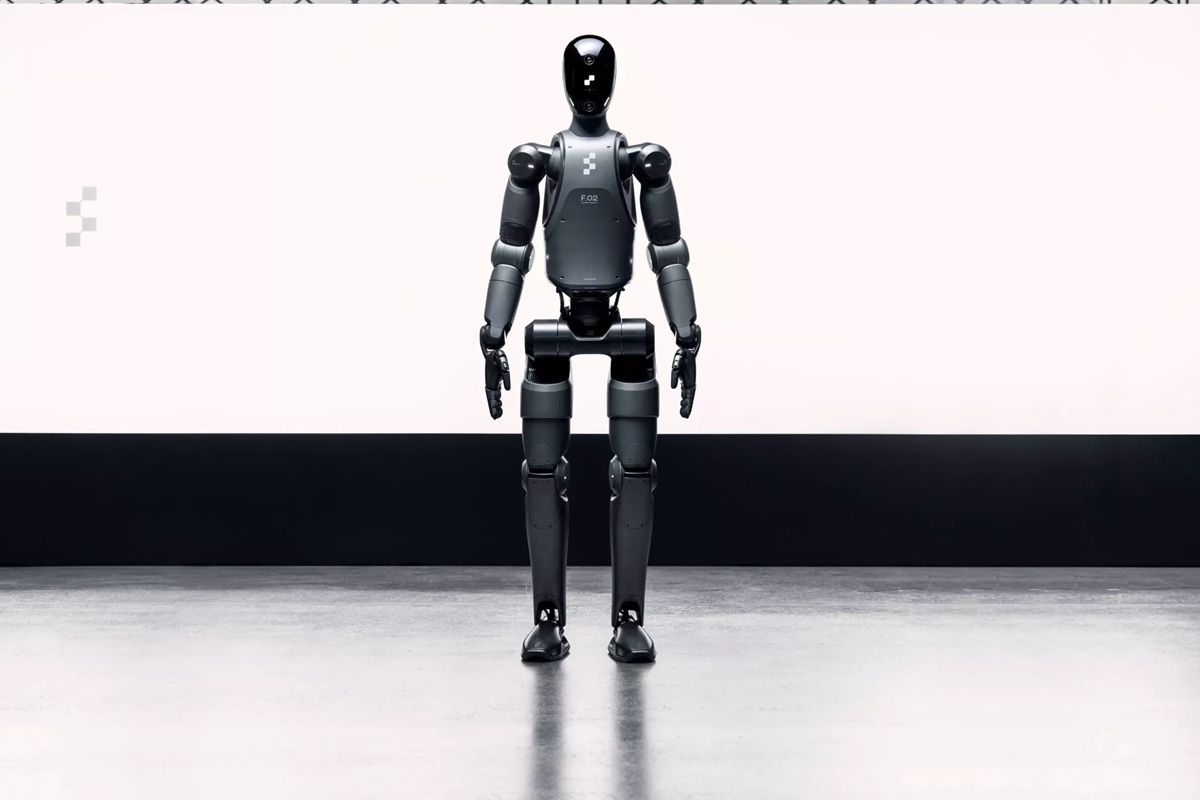

I robot umanoidi promettono da anni una rivoluzione silenziosa nelle case: macchine dalla forma umana in grado di svolgere compiti quotidiani, interagire con l’ambiente circostante e convivere con le persone come se fossero un elettrodomestico avanzato. La corsa alla costruzione di “assistenti universali” è arrivata anche in Spagna e offre già una serie di interessanti possibilità, ma una delle aziende che più si distingue è Figure AI. Questa azienda californiana, fondata da Brett Adcock, è diventata uno dei volti visibili della nuova generazione di assistenti meccanici. La sua proposta si articola attorno a tre generazioni di robot: Figure 01, il suo primo prototipo; Figure 02, un modello più avanzato incentrato sulla manipolazione di precisione; e Figure 03, l’evoluzione più recente pensata per la produzione su larga scala e le case del futuro. L’obiettivo è che questi robot si integrino nella vita quotidiana senza attriti. Il rischio, come si è appena scoperto, è la potenza che nascondono sotto il loro scheletro metallico. Nel pieno boom dell’interesse per gli umanoidi, alimentato anche dai progressi nell’IA generativa e dai miglioramenti nella mobilità autonoma, un nuovo scandalo riporta l’attenzione sulla sicurezza di queste macchine. E questa volta proviene dall’interno della stessa azienda.

L’ex responsabile della sicurezza denuncia che il Figure 02 può fratturare il cranio umano

Il 21 novembre 2025, Robert Gruendel, ex responsabile della sicurezza dei prodotti dell’azienda, ha presentato una denuncia federale in California accusando Figure AI di ignorare gli avvertimenti critici sulla potenza reale dei suoi robot. Secondo la sua dichiarazione, il modello al centro del problema è il Figure 02, un umanoide in grado di generare una forza sufficiente a fratturare il cranio di un adulto in caso di impatto diretto.

Gruendel riferisce che, durante i test interni, uno dei robot ha accidentalmente colpito un frigorifero con una forza tale da ammaccarlo, un incidente che, se fosse avvenuto contro una persona, avrebbe avuto gravi conseguenze. Egli afferma inoltre che sia il CEO, Brett Adcock, sia l’ingegnere capo, Kyle Edelberg, hanno minimizzato questi rischi anche dopo un round di finanziamenti multimilionari e che la sua proposta di roadmap di sicurezza è stata direttamente eliminata.

Poco dopo aver sollevato i suoi avvertimenti, Gruendel è stato licenziato. Egli sostiene che si tratti di una ritorsione, mentre l’azienda sostiene che la decisione è dovuta a scarse prestazioni. Al di là del conflitto lavorativo, la denuncia sottolinea un problema di fondo: la possibilità che un robot domestico apparentemente innocuo possa eseguire movimenti con forza letale.

Cosa dice la denuncia?

La denuncia sottolinea che, fin dall’inizio, non esistevano procedure formali di sicurezza, rapporti sugli incidenti o valutazioni dei rischi specifici. L’unico responsabile esterno della sicurezza era un appaltatore senza esperienza nel campo della robotica.

Secondo Gruendel, i dirigenti tolleravano i guasti, hanno scartato in una fase precedente controlli chiave come un pulsante di arresto di emergenza (E-Stop) perché “non piacevano esteticamente” e hanno modificato il piano di sicurezza prima di presentarlo agli investitori, cosa che lui interpreta come una pratica potenzialmente fraudolenta.

Cosa afferma Figure AI

L’azienda respinge completamente la versione dell’ex ingegnere. Nella sua risposta ufficiale, Figure AI assicura che le accuse sono “false” e che intende difendersi “con fermezza” in tribunale. Secondo l’azienda, il licenziamento di Robert Gruendel non ha nulla a che vedere con i suoi avvertimenti sulla sicurezza, ma con un presunto scarso rendimento nel suo lavoro.

Nei suoi comunicati, l’azienda insiste sul fatto che il suo team lavora secondo standard rigorosi e che la sicurezza fa parte della progettazione di ciascuno dei suoi modelli. Sottolinea inoltre che il denunciante sta presentando un’immagine distorta del processo interno con affermazioni che, secondo loro, non riflettono la realtà dello sviluppo del robot Figure 02, l’umanoide contestato nella denuncia.

Figure AI si difende sostenendo di essere immersa in un processo di innovazione accelerata, ma nega categoricamente di aver ridotto i controlli essenziali o di aver deliberatamente sottovalutato i rischi dei suoi robot. Per l’azienda, la causa è un tentativo di screditare il suo lavoro in un momento di alta visibilità mediatica.

L’arrivo degli umanoidi nelle case apre un dibattito urgente sulla sicurezza

Figure AI aspira a distribuire decine di migliaia dei suoi modelli, compreso il più avanzato Figure 03, in ambienti reali nei prossimi anni. Ma questo caso mette in luce i rischi di accelerare l’adozione di umanoidi senza un chiaro quadro di supervisione esterna. Per spostare pesi, manipolare oggetti e operare con precisione, questi robot hanno bisogno di motori potenti… e quella stessa potenza può rappresentare un pericolo se qualcosa va storto o se il design non incorpora freni e controlli ridondanti.

Il caso di Figure 02 illustra questa tensione tra innovazione e sicurezza. Se un robot in grado di convivere in un salotto può, in determinate circostanze, generare una forza sufficiente a causare lesioni gravi, la discussione su normative, controlli e responsabilità diventa inevitabile. L’industria avanza rapidamente, ma la legislazione e i protocolli di sicurezza sono ancora in ritardo.